Un aggiornamento di Claude Code, lo strumento di programmazione assistita da intelligenza artificiale di Anthropic, ha involontariamente incluso un file di source map contenente l’intera codebase TypeScript. L’incidente, segnalato per la prima volta da un utente su X, è avvenuto con il rilascio della versione 2.1.88. Secondo quanto riportato da The Verge e da altre pubblicazioni come Ars Technica e VentureBeat, i dati trapelati contengono più di 512.000 righe di codice. Anthropic ha dichiarato che si è trattato di un problema di packaging causato da errore umano, non di una violazione della sicurezza, e che non sono stati esposti dati sensibili dei clienti o credenziali. L’azienda ha prontamente risolto l’issue, ma non prima che il codice venisse copiato in un repository su GitHub.

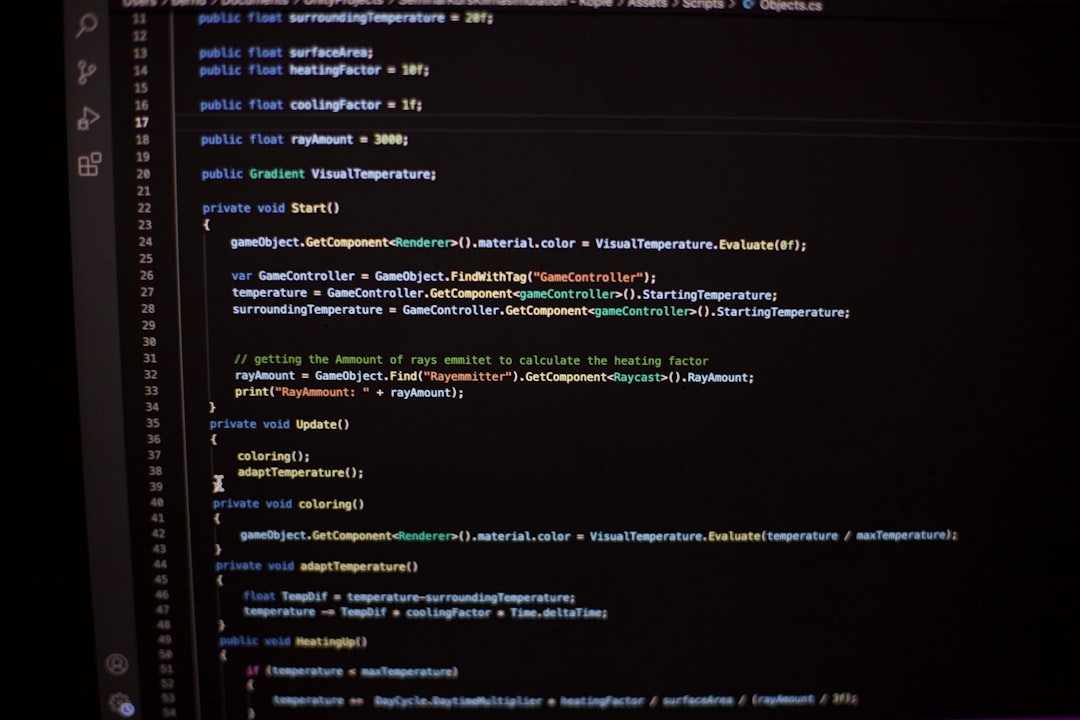

L’analisi del codice trapelato ha offerto uno sguardo senza precedenti sull’architettura interna di Claude Code. Tra le scoperte più rilevanti, gli sviluppatori hanno individuato riferimenti a funzionalità non pubbliche, tra cui un sistema simile a un ‘pet’ in stile Tamagotchi e un agente progettato per operare in modalità ‘always-on’. Queste scoperte forniscono indicazioni concrete sulla direzione di sviluppo di Anthropic, in particolare riguardo alle capacità agentiche che il tool ha iniziato a integrare dopo il lancio di febbraio 2025. Per gli sviluppatori e i ricercatori, questo leak rappresenta un caso studio unico sull’implementazione di un sistema AI complesso in un ambiente di produzione, offrendo spunti su pattern architetturali, gestione dello stato e meccanismi di orchestrazione delle attività autonome.

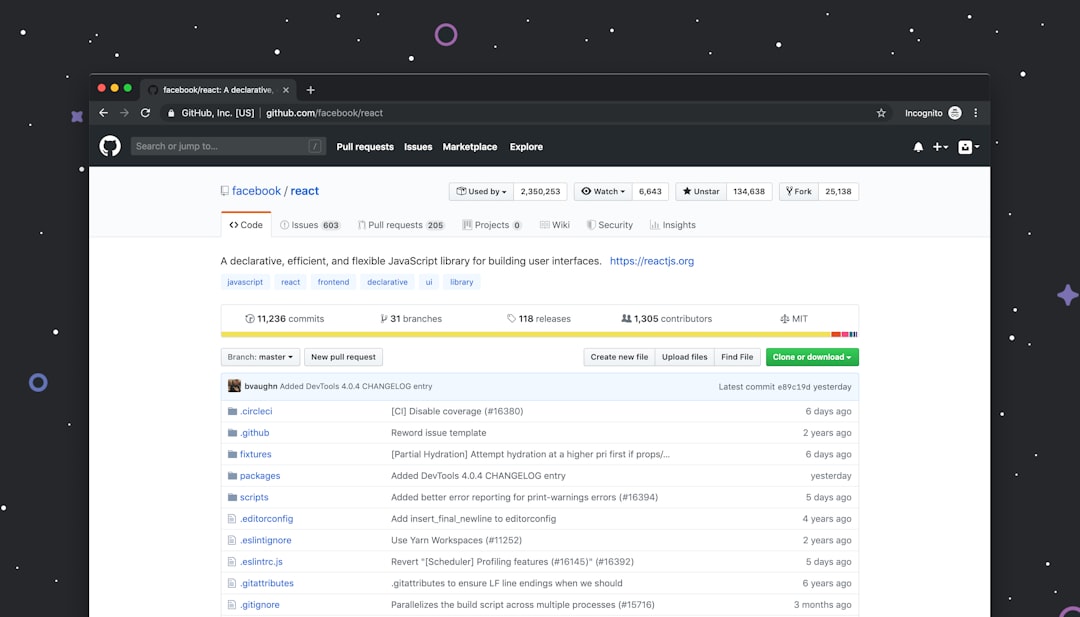

Nonostante Anthropic abbia minimizzato l’incidente definendolo un errore di packaging, l’analista di Gartner Arun Chandrasekaran ha evidenziato rischi concreti. Il codice esposto potrebbe potenzialmente fornire a soggetti malevoli informazioni utili per identificare vulnerabilità o eludere i guardrail di sicurezza dell’AI. La diffusione massiva del repository, con oltre 50.000 fork su GitHub, rende il contenuto di fatto permanente e di pubblico dominio, complicando qualsiasi tentativo di contenimento. La fonte originale non menziona rischi specifici legati alla proprietà intellettuale, ma è ragionevole inferire che la pubblica disponibilità di logiche di business e scelte implementative possa offrire un vantaggio competitivo ad attori concorrenti. Il principale limite dichiarato è l’assenza di dati sensibili, ma il rischio risiede nell’analisi offensiva del codice stesso.

Questo evento si inserisce in un trend più ampio di crescente complessità operativa per le aziende che sviluppano modelli di AI avanzati. La gestione degli artefatti di build e dei processi di rilascio diventa un fattore critico di sicurezza, al pari della protezione dei modelli stessi. L’incidente potrebbe accelerare l’adozione di pratiche di ‘Shift-Left Security’ nello sviluppo di AI, integrando controlli automatici nel pipeline CI/CD per prevenire fughe di codice sorgente. La domanda aperta per i professionisti del settore è come bilanciare la velocità di innovazione, necessaria in un mercato competitivo, con la robustezza dei processi interni, soprattutto quando gli strumenti stessi acquisiscono capacità agentiche che operano in ambienti utente. La trasparenza forzata generata da questo leak costringerà altre aziende a rivedere i propri standard?

Alessio Baronti

Consulente Strategico AI & Sviluppatore Web