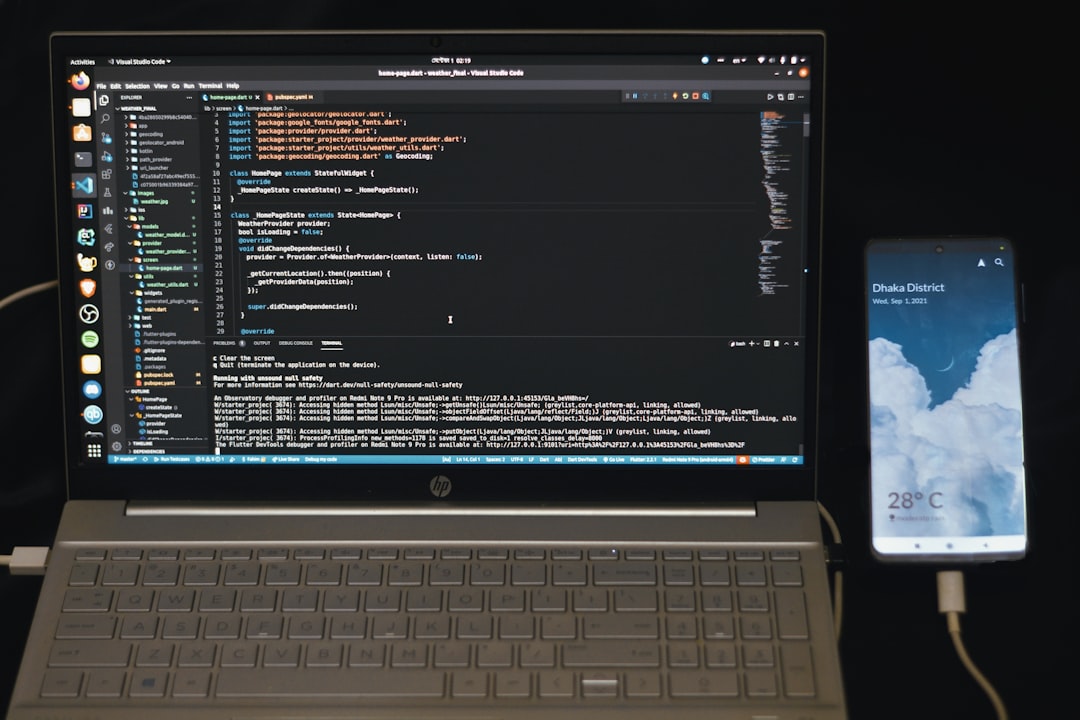

Simon Willison, sviluppatore e autore noto nel settore dell’intelligenza artificiale, ha recentemente formalizzato il concetto di agentic engineering in una guida pubblicata sul suo sito. Willison definisce questa pratica come lo sviluppo di software con l’assistenza di coding agent. Questi agenti sono software capaci sia di scrivere codice che di eseguirlo. Esempi concreti includono Claude Code, OpenAI Codex e Gemini CLI. La definizione operativa di agente proposta da Willison, specifica per il contesto dei Large Language Model, è: software che esegue strumenti in un ciclo per raggiungere un obiettivo. L’agente chiama un LLM con un prompt, gli fornisce una serie di definizioni di strumenti, chiama gli strumenti richiesti dall’LLM e reinvia i risultati al modello. Per i coding agent, questi strumenti includono la capacità di eseguire codice. L’utente fornisce all’agente un obiettivo, e l’agente genera ed esegue codice in un ciclo fino al suo raggiungimento. L’esecuzione del codice è la capacità fondamentale che rende possibile l’agentic engineering. Senza di essa, l’output di un LLM ha valore limitato; con essa, gli agenti possono iterare verso software che funziona dimostrabilmente. La fonte originale è disponibile sul sito di Simon Willison.

L’impatto pratico dell’agentic engineering si concentra sul cambiamento del ruolo dell’ingegnere del software. Il lavoro non si riduce più alla sola scrittura manuale del codice, ma si sposta verso attività di definizione del problema, selezione degli strumenti appropriati per l’agente e validazione dei risultati. Gli sviluppatori devono fornire agli agenti gli strumenti necessari per risolvere problemi specifici, specificare questi problemi con il giusto livello di dettaglio e verificare e iterare sui risultati fino a ottenere soluzioni robuste e credibili. Questo approccio può aumentare l’ambizione dei progetti intrapresi, permettendo ai team di produrre più codice di qualità superiore per problemi con maggiore impatto. I beneficiari diretti sono sviluppatori, product manager e team di ricerca e sviluppo che possono automatizzare parti ripetitive della prototipazione, esplorare più rapidamente diverse soluzioni architetturali o gestire la manutenzione di codice legacy.

La pratica presenta limiti tecnici e rischi intrinseci. Willison osserva che gli LLM non apprendono automaticamente dai propri errori passati. L’apprendimento dipende dall’aggiornamento deliberato delle istruzioni e dell’ambiente di strumenti da parte dell’ingegnere umano, basandosi su quanto appreso durante il processo. Questo introduce un rischio di over-reliance, dove lo sviluppatore potrebbe accettare output funzionanti ma non ottimali o sicuri senza un’adeguata verifica. La qualità del risultato finale dipende criticamente dalla qualità del prompt iniziale e dalla progettazione dell’harness di strumenti. Esiste il rischio che il codice generato incorpori vulnerabilità di sicurezza, pattern inefficienti o dipendenze non gestite se non sottoposto a scrutinio. Inoltre, la distinzione tra agentic engineering e vibe coding – un termine coniato da Andrej Karpathy per descrivere il prompting di LLM per codice mentre ci si dimentica della sua esistenza – è sottile ma cruciale. L’agentic engineering richiede un coinvolgimento attivo e iterativo, non un approccio passivo.

L’agentic engineering si inserisce in un trend più ampio di automazione e amplificazione delle capacità umane nello sviluppo software. Rappresenta un’evoluzione rispetto all’uso statico di LLM come assistenti per la generazione di snippet di codice, spostandosi verso un’interazione dinamica e ciclica. Lo sviluppo futuro plausibile include l’integrazione di questi agenti in ambienti di sviluppo più complessi, con accesso a suite di strumenti più ampie per testing, debugging e deployment. La ricerca si concentrerà probabilmente su come progettare prompt e ambienti di esecuzione più efficaci, e su come misurare la robustezza e l’affidabilità del codice prodotto in modo autonomo. Una domanda aperta per i professionisti del settore è come bilanciare l’efficienza guadagnata con la necessità di mantenere una comprensione profonda dei sistemi costruiti e del controllo sulla loro architettura finale.

Alessio Baronti

Consulente Strategico AI & Sviluppatore Web